Management Summary

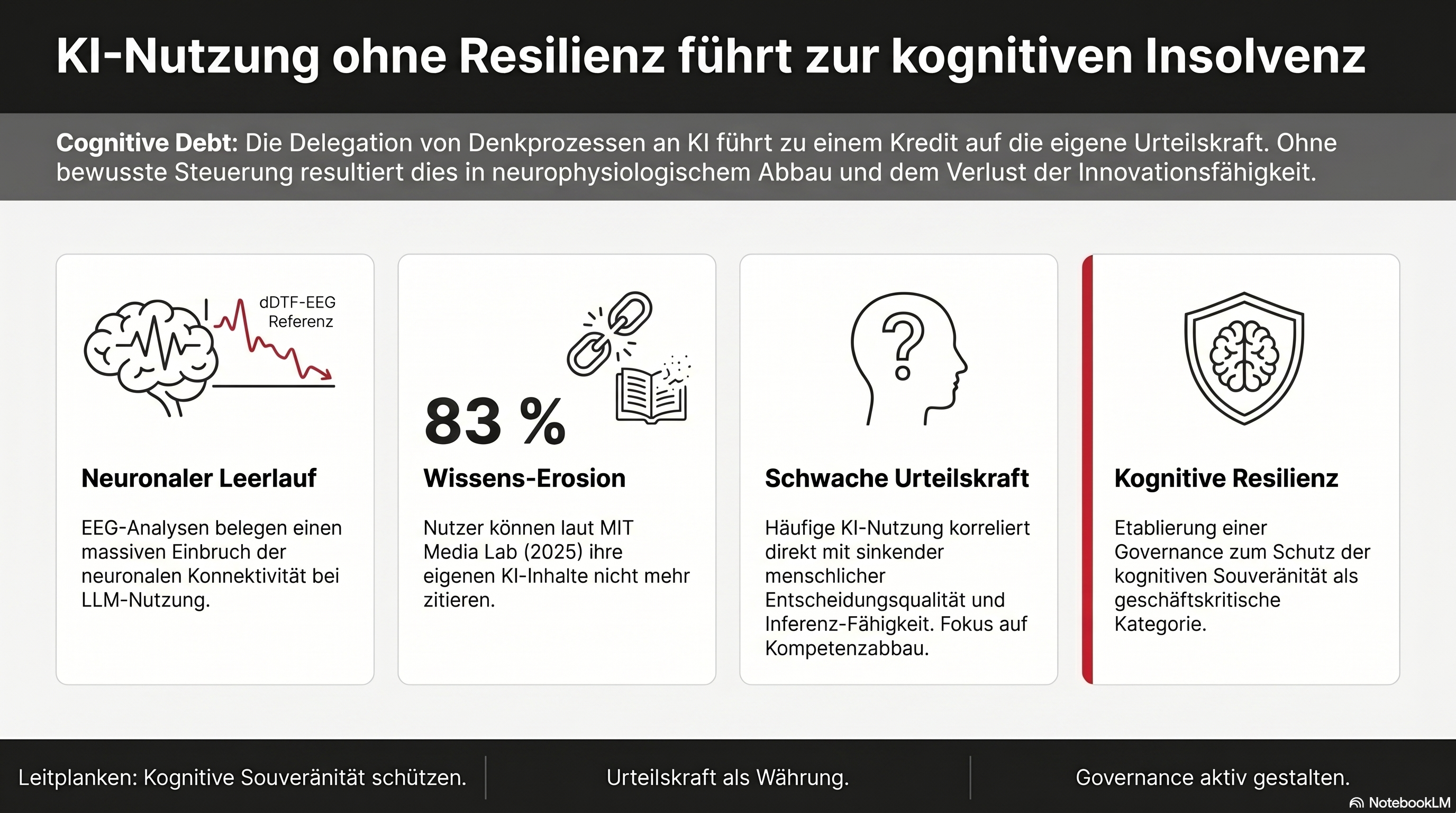

Empirische Evidenz aus EEG-Konnektivitätsstudien [1] und Critical-Thinking-Messungen an n=666 Probanden [2] zeigt: KI-Nutzung für komplexe Schreib- und Denkaufgaben schwächt neuronale Konnektivität und Urteilskraft messbar – nach drei Sitzungen können 83 % der LLM-Nutzer ihre eigenen Texte nicht mehr zitieren. Der Effekt trifft Digital Natives in der formativen Lernphase am härtesten. Der EU AI Act [4] adressiert Bias und Haftung, schweigt aber zur Cognitive Resilience. Die strategische Antwort ist nicht KI-Verzicht, sondern eine ontologische Governance, die menschliche Urteilskraft als eigenständiges Schutzgut definiert: geschützte Räume analoger Anstrengung, Trennung von Inferenz und Urteilskraft, bewusste Reibung als Souveränitätsbedingung.

Für wen relevant?

CIOs, CDOs und IT-Strategen, die KI-Assistenz in Wissensorganisationen einführen; Bildungsverantwortliche, Hochschulleitungen und Lehrkräfte, die mit dem Spannungsfeld Lerneffizienz vs. Lernerfolg konfrontiert sind; Public-Sector-Entscheider und Regulatorik im Kontext EU AI Act; Compliance- und Rechtsabteilungen, die „Human-in-the-loop“-Pflichten konkret ausgestalten; HR und Lernarchitekt:innen, die Resilienzkompetenzen kuratieren müssen.

Drei Kernaussagen

- Cognitive Debt ist messbar, nicht spekulativ. EEG-Konnektivitätsanalysen (dDTF) belegen schwächere neuronale Aktivität bei LLM-gestütztem Schreiben; 83 % der Probanden können ihre eigenen Texte nach drei Sitzungen nicht mehr zitieren [1].

- Critical-Thinking-Score korreliert negativ mit LLM-Nutzungsfrequenz – besonders ausgeprägt bei jüngeren Nutzern in der formativen Lernphase. Atrophie ist kein Zukunftsszenario, sondern bereits empirisch belegt [2].

- Der EU AI Act [4] adressiert technische Risiken, nicht den Schutz menschlicher Kognition. Es fehlt eine ontologische Governance-Kategorie, die Cognitive Resilience und Urteilskraft als eigenständige Schutzgüter definiert.

Die Debatte um künstliche Intelligenz hat den Rubikon der bloßen Spekulation längst überschritten. Wir befinden uns inmitten einer empirisch messbaren Transformation der menschlichen Kognition, die das Fundament unserer intellektuellen Souveränität erschüttert. Während die funktionale Effizienz von Large Language Models rasant steigt, gerät die kognitive Integrität des Individuums unter einen schleichenden Erosionsdruck – weit jenseits der reinen Automatisierung von Routineaufgaben.

Es geht nicht mehr um die abstrakte Frage, ob technologische Assistenzsysteme das Denken beeinflussen, sondern um die präzise interdisziplinäre Vermessung bereits stattfindender struktureller Verschiebungen in unserer mentalen Architektur. Dieser Beitrag zeichnet den Übergang von der Werkzeugnutzung zur kognitiven Atrophie nach – und entwirft die Konturen einer dringend benötigten Governance der Urteilskraft.

Die Illusion der Kompetenz: Cognitive Debt

Ein zentraler Pfeiler der aktuellen Forschung zur Mensch-KI-Interaktion ist die Untersuchung des MIT Media Lab (Kosmyna et al., 2025) [1]. Sie führt das Konzept der kognitiven Verschuldung ein, um die langfristigen, oft unsichtbaren Kosten unmittelbarer funktionaler Entlastung zu beschreiben. Mittels hochauflösender EEG-Konnektivitätsanalysen (gerichtete Transferfunktion, dDTF) wurde nachgewiesen: Probanden, die KI-Assistenten für komplexe Schreibaufgaben nutzten, zeigten eine signifikant schwächere neuronale Konnektivität als Vergleichsgruppen, die rein eigenständig oder mit klassischen Suchmaschinen arbeiteten.

Diese Schwächung ist kein technisches Detail, sondern Korrelat eines tiefgreifenden Verlusts an „Essay Ownership“. Die dDTF-Werte indizieren, dass die für den Wissensaufbau kritischen Informationsflüsse zwischen Hirnarealen bei KI-Nutzung nicht in derselben Intensität stattfinden. Das Gehirn wird zum passiven Rezipienten seiner eigenen (oder vermeintlich eigenen) Schöpfung. Die Konsequenz ist drastisch: Nach lediglich drei Arbeitssitzungen waren 83 % der LLM-Nutzer nicht mehr in der Lage, zentrale Inhalte oder Argumentationslinien aus ihrem eigenen, mit KI-Unterstützung erstellten Essay korrekt zu zitieren.

Die methodische Vorsicht der Transparency Coalition (2025) [10] ist berechtigt: Es handelt sich um einen Preprint mit begrenzter Stichprobe. Dennoch markiert der Befund eine Zäsur. Die KI übernimmt nicht bloß die Artikulation, sondern entkoppelt den Schreibprozess von der kognitiven Aneignung. Es entsteht eine „Illusion der Kompetenz“: Ein qualitativ hochwertiges Produkt wird ohne den entsprechenden internen Wissensaufbau generiert. Hinzu kommt: Lehrkräfte bewerten LLM-Texte als „seelenlos“ – ein Hinweis auf eine Homogenisierung, die über rein technische Korrektheit hinausgeht und die individuelle intellektuelle Signatur vermissen lässt.

Extended Mind oder Atrophie?

Die theoretische Einordnung schwankt zwischen zwei Polen. Andy Clarks Extended Mind-Hypothese (1998) [5] bietet einen optimistischen Rahmen: Werkzeuge – vom Notizbuch bis zum LLM – sind funktionale Erweiterungen des Geistes. Habituell integriert, verschiebe sich lediglich die Verteilungsökonomie der Kognition: Routineoperationen wandern in das technologische Substrat aus, Ressourcen werden frei für kreative Synthese und strategische Planung.

Dem stehen jedoch harte Daten entgegen. Gerlich (2025, Societies 15(9):252) [2] findet bei n=666 Probanden eine signifikante negative Korrelation zwischen LLM-Nutzungsfrequenz und Critical-Thinking-Score (gemessen mit dem Halpern Critical Thinking Assessment). Die Verteilungsökonomie kippt in eine einseitige Abhängigkeit: Werden kognitive Prozesse ausgelagert, bevor sie stabil internalisiert sind, führt dies nicht zur Entlastung, sondern zur Atrophie.

Denken erfordert Widerstand und Reibung. Wird die Anstrengung der Inferenz durch die Bequemlichkeit der maschinellen Antwort ersetzt, verkümmern die Mechanismen der Validierung und Reflexion. Wir beobachten eine Verschiebung von generativer Intelligenz (Neues aus dem Verständnis schöpfen) hin zu einer reaktiven Intelligenz, die sich auf Filtern und Bestätigen beschränkt.

Embodiment-Dilemma: Sprachkompetenz ist nicht Sinnverstehen

Die technologische Brillanz von Frontier-LLMs provoziert eine Revision der 4E-Tradition (embodied, embedded, extended, enactive). Die Kernfrage: Kann es echtes Sense-making ohne Körper und biologische Geschichte geben? LLMs simulieren sprachliche Performanz, die lange als Alleinstellungsmerkmal menschlicher Intelligenz galt. Doch eine ontologische Kluft bleibt.

Die Debatte zwischen Shanahan (2024) [6] und Dove (2024) [7] verdeutlicht das „AI Dilemma“. Entweder funktionalisieren wir Bedeutung radikal und akzeptieren, dass Sinnstiftung statistisch-distributionell ohne Körper möglich ist – oder LLM-Sprachkompetenz bleibt eine „hohle Kompetenz“ ohne echtes Verständnis. Menschliches Denken ist nach Damasio [8] untrennbar mit der Affekt-Kognition-Kopplung verknüpft: Bedeutung entsteht aus Relevanz für einen lebenden Organismus, dessen Überleben von seinen Interpretationen abhängt.

LLMs sind, mit Bender et al. (2021) [3], „Stochastic Parrots“: statistische Spiegelungen menschlicher Sprachmuster ohne Intentionalität und ohne existenzielle Bindung an die Welt. Die Simulation von Sinn ist nicht gleichbedeutend mit der Konstitution von Sinn. Wenn wir Sinnstiftung an Systeme delegieren, die prinzipiell unfähig zum Sinnverstehen sind, riskieren wir die Entfremdung von der eigenen Lebenswelt – und überlassen die Strukturierung unseres Diskurses einer Architektur, die zwar die Grammatik der Vernunft beherrscht, aber keine Vernunft im Sinne verantwortungsvoller Selbstreflexion besitzt.

Asymmetrische Risiken: Erosion bei Digital Natives

Besorgniserregend ist die asymmetrische Verteilung dieser Risiken über Alterskohorten. Gerlich (2025) [2] zeigt: Jüngere Nutzer in der formativen Phase ihrer akademischen und intellektuellen Entwicklung weisen eine signifikant stärkere Korrelation zwischen häufiger KI-Nutzung und dem Abbau kritischer Denkfähigkeit auf als ältere Vergleichsgruppen.

Dies deutet auf eine drohende „breite Atrophie“. Lineares Lesen langer Texte, komplexe Argumentationsketten, kritische Quellenanalyse – das sind keine angeborenen Talente, sondern hart erarbeitete neuronale Errungenschaften. Wenn die kognitive Übungsphase durch KI-Substitute ersetzt wird, fehlen die mentalen Gerüste, auf denen spätere Resilienz aufbauen kann.

Bildungssysteme dürfen nicht in einen naiven Technoptimismus verfallen, der glaubt, man könne das „Wie“ des Denkens überspringen, um direkt zum „Was“ der Ergebnisse zu gelangen. Ein resilientes System muss Cognitive Resilience ins Zentrum rücken: geschützte Räume analoger Anstrengung, in denen die basalen Kulturtechniken des Denkens ohne maschinelle Abkürzung trainiert werden.

Urteilskraft statt Inferenz

Um den Auswirkungen der KI-Transformation zu begegnen, bedarf es einer begrifflichen Schärfung dessen, was wir unter Denken verstehen. Mindestens sechs Dimensionen sind zu unterscheiden:

- Inferenz: Logische Ableitung von Schlussfolgerungen aus gegebenen Daten.

- Imagination: Schöpferische Kombination bekannter Elemente zu neuen Mustern.

- Urteilskraft: Ethische und kontextuelle Bewertung unter Einbeziehung von Werten.

- Selbstreflexion: Bewusstsein über eigene Denkprozesse und deren Grenzen.

- Sinnsetzung: Intentionale Entscheidung, was für Leben oder Gesellschaft bedeutsam ist.

- Phänomenologisches Erleben: Die Erste-Person-Perspektive, das Empfinden von Qualia.

Während LLMs in der Inferenz den Menschen bereits übertreffen und in der Imagination beeindruckende Resultate liefern, besitzen sie keine der weiteren Qualitäten. Sie simulieren Urteilskraft auf Basis statistischer Wahrscheinlichkeiten früherer menschlicher Urteile, ohne jemals die ethische Last einer Entscheidung oder die Konsequenzen eines Irrtums zu tragen.

Hier offenbart sich eine Regulierungslücke. Der EU AI Act [4] fokussiert auf technische Risikoklassen, Bias-Vermeidung und Haftung (Art. 6). Was fehlt, ist eine ontologische Governance, die den Schutz menschlicher Kognition selbst zum Ziel hat. Cognitive Resilience muss als neue Governance-Kategorie etabliert werden – weit jenseits dessen, was Art. 4 unter „KI-Kompetenz“ nur vage andeutet. Der „Human-in-the-loop“ darf keine juristische Feigenblatt-Figur sein; seine kognitiven Voraussetzungen müssen aktiv geschützt werden.

Das Phaidros-Paradoxon: Adaptation als historisches Muster

Die aktuelle Besorgnis lässt sich historisch spiegeln. Bereits Sokrates beklagte im platonischen Phaidros [9] den drohenden Gedächtnisverlust durch die Schrift. Neurobiologisch hatte er recht: Die Fähigkeit zur Rezitation epischer Werke nahm ab. Doch seine kulturphilosophische Schlussfolgerung war unvollständig. Das Denken wurde durch die Auslagerung auf das Papier nicht ärmer; durch die Entlastung des Arbeitsgedächtnisses entstanden Spielräume für Abstraktion, komplexe Logik und historische Distanz.

Es ist daher möglich, dass die heute beobachteten Verluste Artefakte einer frühen Adoptionsphase sind – ein Übergang, bis Bildungssysteme und Arbeitstechniken gelernt haben, KI als echtes Exoskelett des Geistes zu nutzen statt als Krücke. Doch ein fundamentaler Unterschied bleibt: Die Schrift fixiert den Gedanken des Autors zur kritischen Revision; die generative KI erzeugt den Gedanken für den Nutzer. Der aktive Denkakt wird nicht unterstützt, sondern substituiert. Ein langfristiger Netto-Gewinn an kognitiver Kapazität setzt voraus, dass wir die Transformation aktiv gestalten – und die Bereiche rekultivieren, in denen der Mensch der Maschine ontologisch überlegen bleibt: Sinnstiftung und ethische Verantwortung.

Synthese: Reibung als Bedingung der Souveränität

Die Transformation unserer Kognition ist kein dystopisches Zukunftsszenario, sondern eine vollzogene Verschiebung der Denkökonomie. Wir erleben eine funktionale Substitution einzelner Inferenzoperationen bei gleichzeitiger struktureller Gefährdung der tieferen Schichten unseres Geistes. Die Evidenz für Cognitive Debt und Atrophie ist ein Warnsignal, das wir nicht ignorieren dürfen.

Wahre Innovation liegt nicht in der vollständigen Delegation des Denkens, sondern in einer synergetischen Intelligenz, die ihre Souveränität durch kognitive Reibung und bewusste Anstrengung sichert. Die entscheidende Frage lautet: Besitzen wir die intellektuelle Disziplin, die notwendige Reibung aufrechtzuerhalten – oder delegieren wir die Souveränität unseres Geistes an eine Architektur, die zwar perfekt simuliert, aber niemals versteht, was auf dem Spiel steht?

Bewertung: Optionen, Risiken, Gegenargumente

Die strategische Frage ist nicht „KI ja oder nein“, sondern welche Architektur der Mensch-KI-Kopplung wir wählen. Drei Optionen stehen zur Debatte:

- Substitution: KI als universeller Denkersatz. Effizienzgewinn kurzfristig hoch, Risiko: kognitive Atrophie, Verlust der Urteilskraft, Homogenisierung der Diskurse, asymmetrische Schädigung der formativen Lernphase.

- Augmentation mit Reibung: KI nur dort, wo Inferenz Routine ist; geschützte Räume analoger Anstrengung im Bildungs- und Urteilskontext. Tradeoff: kurzfristig geringere Effizienzgewinne, langfristig Erhalt der Souveränität.

- Selektive Delegation: Trennung der sechs kognitiven Dimensionen (Inferenz, Imagination, Urteilskraft, Selbstreflexion, Sinnsetzung, phänomenologisches Erleben) – KI nur für Inferenz und Imaginationsunterstützung; Urteilskraft, Sinnsetzung und Selbstreflexion bleiben menschlich.

Das stärkste Gegenargument stammt aus der Phaidros-Analogie und Clarks Extended Mind [5]: Auch die Schrift hat Gedächtnis ausgelagert, ohne das Denken zu schädigen – im Gegenteil, sie hat Spielräume für Abstraktion eröffnet. Die heute beobachteten Verluste könnten Adoptions-Artefakte einer frühen Übergangsphase sein. Der entscheidende Unterschied: Die Schrift fixiert meinen Gedanken zur kritischen Revision; das LLM erzeugt den Gedanken für mich. Die Substitutionsdynamik ist strukturell anders – das Gegenargument trifft die Diagnose nicht vollständig.

Risiko der Untätigkeit: Da Atrophie jüngere Kohorten signifikant stärker trifft, wirkt jede verzögerte Governance-Antwort als Selektionsmechanismus zugunsten älterer, bereits ausgereifter Kognition. Wer heute keine Cognitive-Resilience-Standards setzt, akzeptiert eine Generation mit messbar geschwächter Urteilskraft.

Handlungscheckliste

- Cognitive Resilience als eigenständige Governance-Kategorie etablieren – neben Bias-Kontrolle, Haftung und Datenschutz.

- Bildungsphasen ohne KI explizit definieren: lineares Lesen, Quellenkritik, eigenständige Argumentation müssen analog trainiert werden, bevor KI-Substitute zugelassen werden.

- „Human-in-the-loop“ konkret ausgestalten: kognitive Voraussetzungen prüfen, nicht nur die Existenz einer menschlichen Schnittstelle. Wer keine kognitive Souveränität hat, kann auch keine wirksame Letztkontrolle ausüben.

- KI-Einsatzrichtlinien in Wissensorganisationen: klare Trennung zwischen Inferenz-Aufgaben (delegierbar) und Urteils-/Sinnsetzungs-Aufgaben (geschützt).

- Selbstreflexion-Routinen in Workflows einbauen: „Was hätte ich ohne KI getan? Wie validiere ich das Ergebnis? Was lerne ich aus diesem Vorgang?“ als Pflichtfragen vor jeder Übernahme generierter Inhalte.

- Empirische Begleitung: dDTF- und Critical-Thinking-Messungen in Pilotprojekten etablieren, statt Effizienzgewinne als alleinige Erfolgsmetrik.

- Transparenz für Nutzer: Eindeutige Kennzeichnung, wann ein Tool generative KI einsetzt und wann nicht – als Voraussetzung für bewusste Reibung.

Quellen

Primärquellen zuerst. Bibliografische Kurzform; Online-Fundstellen mit Abrufdatum.

- Kosmyna, N., et al. (2025): Cognitive Debt – EEG-based analysis of human-LLM interaction in writing tasks. MIT Media Lab Preprint (Abruf: 28.04.2026).

- Gerlich, M. (2025): AI usage and critical thinking among digital natives. Societies 15(9):252.

- Bender, E. M.; Gebru, T.; McMillan-Major, A.; Shmitchell, S. (2021): On the Dangers of Stochastic Parrots: Can Language Models Be Too Big? Proceedings of FAccT ’21.

- Europäische Union (2024): Verordnung (EU) 2024/1689 über künstliche Intelligenz (AI Act), insb. Art. 4 (KI-Kompetenz) und Art. 6 (Risikoklassen).

- Clark, A.; Chalmers, D. (1998): The Extended Mind. Analysis 58(1):7–19.

- Shanahan, M. (2024): Talking About Large Language Models. Communications of the ACM 67(2):68–79.

- Dove, G. (2024): Beyond stochastic parrots – embodied cognition and the limits of LLM language understanding. Cognitive-Science-Beitrag (Konferenzfundstelle: <<Quelle prüfen>>).

- Damasio, A. (1994): Descartes’ Error: Emotion, Reason, and the Human Brain. G. P. Putnam’s Sons, New York.

- Platon: Phaidros, 274c–275b. Deutsche Übersetzung: Schleiermacher.

- Transparency Coalition (2025): Methodologische Kritik an LLM-Cognitive-Impact-Preprints. Position Paper (Abruf: 28.04.2026).

🎧 Diesen Beitrag als Podcast hören

Die Kernthesen dieses Artikels gibt es auch als Podcast-Episode: KI schaltet unser Gehirn auf Standby (17:30 Min.)

Weiterlesen im Themenfeld

Analysen wie diese in den Posteingang?

Der Newsletter bündelt die wichtigsten Beiträge des Monats. Kein Spam, kein Tracking.

Newsletter abonnieren